Forschungsprojekt KIGVI

| Projektname: | KIGVI - Automatische KI-gestützte Generierung von Videoreportagen |

| Fachbereich: | Ingenieurwissenschaften - Medientechnik |

| Leitung: | Prof. Dr.-Ing. Matthias Narroschke |

Projektbeteiligte:

|

|

| Projektpartner: | Qvest GmbH, Köln |

| Laufzeit: | 01.05.2021 - 31.10.2026 |

| Finanzierende Institution oder Auftraggeber: | Gefördertes BMFTR-Projekt (FH-Kooperativ Förderkennzeichen 13FH544KX9) |

Ziel des Projekts ist eine innovative Lösung zur KI-basierten Erstellung von Reportagen, die aus Videosequenzen geeignete Abschnitte extrahiert und zu einem sendefähigen Beitrag komponiert. In sozialen Netzwerken, aber auch auf Nachrichtenportalen, ersetzen zunehmend kurze Videoreportagen konventionelle Textbeiträge, um die Aufmerksamkeit der Nutzer zu gewinnen. Für Anbieter von Videoinhalten ist daher eine kostengünstige und effiziente Produktion kurzer Videoreportagen besonders wichtig. Die Erstellung von Videoreportagen erfolgt bisher manuell, was mit großem Zeitaufwand und hohen Kosten verbunden ist.

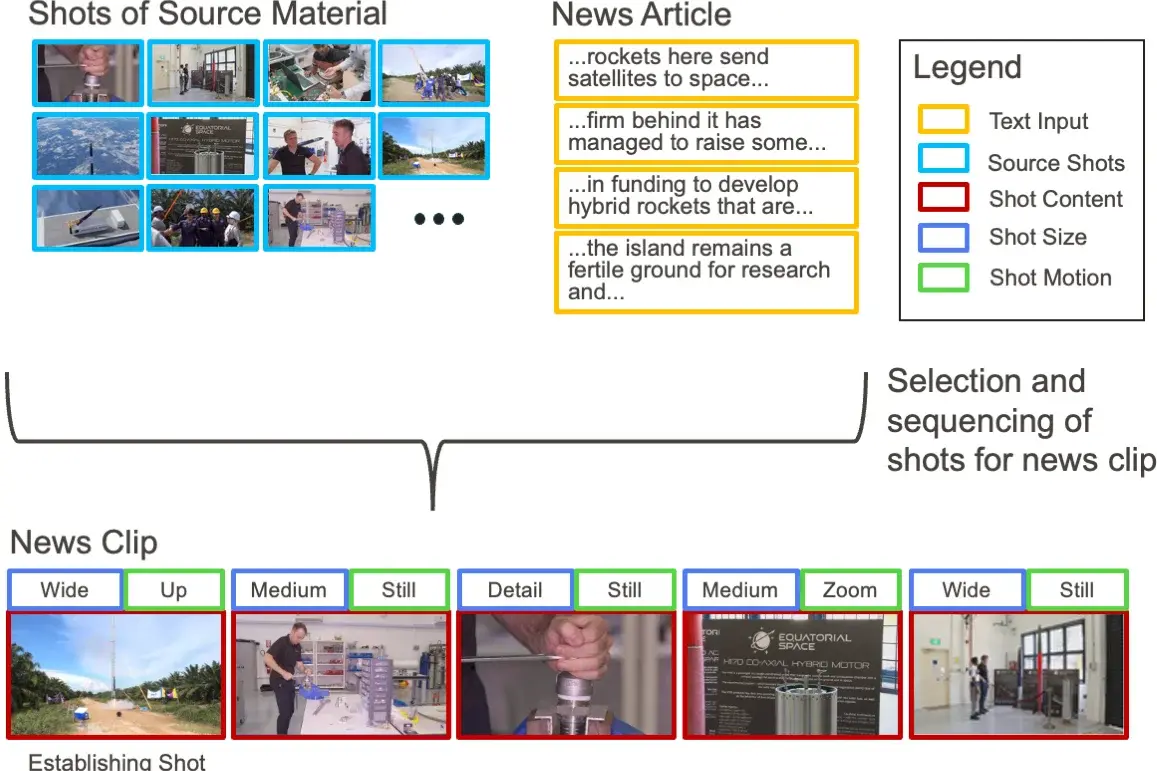

Im Rahmen des Projektes soll daher ein System entwickelt werden, das die Qualitätsbewertung und die Komposition zu einer sendefähigen Reportage automatisch durchführen kann. Dabei lässt sich die Entwicklung in zwei Kernthemen unterteilen. Zum einen ein KI-Modell, mit dem aus vorliegenden Videosequenzen geeignete Videoabschnitte extrahiert werden und zum anderen ein weiteres Modell, das aus den extrahierten Abschnitten die Videoreportage erzeugt. Dazu sollen für die extrahierten Videoabschnitte automatisch geeignete Parameter geschätzt werden, die relevante Qualitätsmerkmale beschreiben.

Neben rein technischen Merkmalen, wie Bildauflösung und Konformität zu Videostandards, sollen auch inhaltliche und stilistische Merkmale definiert und entsprechende Parameter geschätzt werden. Hierzu zählen zum Beispiel die Kategorisierung der Abschnitte in „Hintergrundmaterial“, „Mitschnitt“, „Interview“ oder „Original-Ton-Sequenz“, oder die Einhaltung des „Goldenen Schnittes“ im Bild. Anhand der geschätzten Parameter sollen die zugehörigen Videoabschnitte mit dem zweiten KI-Modell zu einer sendefähigen Reportage komponiert werden. Dabei sollen insbesondere Genre-abhängige Musterabläufe für Reportagen berücksichtigt werden, die in der Regel unterschiedlich sind, wie etwa für Sport-Nachrichten, Produktvorstellungen oder Politik-Beiträge.

Überblick über den Auswahl- und Sequenzierungsprozess für einen Nachrichtenclip. Die Aufnahmen werden aus dem Ausgangsmaterial anhand der Segmente des Nachrichtenartikels, ihres Inhalts, ihrer Größe und ihrer Bewegung ausgewählt. Anschließend werden sie gemäß den Prinzipien der Videobearbeitung für Nachrichtenclips sequenziert.

Veröffentlichungen & Vorträge

- D. Quandt, P. Altmeyer, W. Ruppel, and M. Narroschke,

"Automatic Text-based Clip Composition for Video News",

Proceedings of 9th International Conference on Multimedia and Image Processing (ICMIP), Osaka, Japan, April 2024, https://doi.org/10.1145/3665026.3665042 - C. Moosburner, D. Quandt, M. Kowald, W. Ruppel, T. Dannewald, and M. Narroschke,

“Evaluating AI Editing Algorithms for Video News Reporting”,

AIMEDIA 2025, The First International Conference on AI-based Media Innovation, Venice, Italy, 2025, https://www.thinkmind.org/library/AIMEDIA/AIMEDIA_2025/aimedia_2025_1_90_40054.html

- D. Quandt, P. Altmeyer, W. Ruppel, and M. Narroschke,

"KI-gestützter Videoschnitt für Nachrichtenclips",

FKTG Journal, 3-2024 - D. Quandt,

"AI-supported video editing framework for news clips",

9th VDE/ITG Graduate Summer School on Video Compression and Processing (SVCP) 2024, Ruedesheim, Germany - D. Quandt,

"Automated AI-based video composition of video News Clips",

EBU Production Technology Seminar 2025, Geneva, Switzerland